Machine Learning com Python é hoje a principal porta de entrada para quem deseja atuar com Inteligência Artificial de forma prática e profissional. Empresas de tecnologia, fintechs, e-commerces e startups utilizam modelos de aprendizado de máquina para automatizar decisões e gerar valor a partir de dados.

Apesar do crescimento da área, muitos desenvolvedores ainda têm dúvidas sobre o que realmente é Machine Learning, como ele funciona na prática e por que Python se tornou o padrão desse ecossistema.

Neste artigo, você entenderá os conceitos fundamentais de Machine Learning, o papel do Python na IA moderna, as principais bibliotecas utilizadas e como iniciar seus estudos de forma estruturada.

O que é Machine Learning?

Machine Learning é um subcampo da Inteligência Artificial que permite que sistemas aprendam padrões a partir de dados, sem a necessidade de regras programadas manualmente para cada cenário.

Portanto,em vez de escrever condições fixas, o desenvolvedor treina um modelo matemático com exemplos, permitindo que ele faça previsões ou classificações sobre novos dados.

Por que Python é a principal linguagem para Machine Learning?

Python se consolidou como a linguagem dominante em Machine Learning por uma combinação de fatores técnicos e estratégicos. São eles:

- Sintaxe simples e produtividade: A sintaxe clara do Python reduz a complexidade do código e facilita o foco nos conceitos matemáticos e estatísticos, em vez de detalhes de baixo nível da linguagem.

- Ecossistema maduro de bibliotecas: O Python possui bibliotecas otimizadas, estáveis e amplamente testadas para análise de dados, aprendizado de máquina e deep learning, acelerando o desenvolvimento de soluções em IA.

- Comunidade e suporte: A grande comunidade garante documentação extensa, exemplos prontos, cursos, artigos técnicos e rápida evolução das ferramentas.

Conceitos fundamentais de Machine Learning

Antes de aplicar modelos em Python, é essencial entender os conceitos básicos que sustentam o aprendizado de máquina.

Tipos de aprendizado

Aprendizado supervisionado

Utiliza dados rotulados para treinar modelos de classificação ou regressão.

Exemplos: previsão de preços, detecção de spam, classificação de imagens.

Aprendizado não supervisionado

Trabalha com dados sem rótulos para identificar padrões ou agrupamentos.

Exemplos: segmentação de clientes, análise exploratória de dados.

Aprendizado por reforço

O modelo aprende por tentativa e erro, recebendo recompensas ou penalidades.

Exemplos: jogos, robótica, sistemas de recomendação adaptativos.

Pipeline básico de Machine Learning em Python

Um projeto de Machine Learning com Python segue um pipeline bem definido que garante qualidade dos dados, confiabilidade dos modelos e reprodutibilidade dos resultados. Cada etapa possui objetivos claros e ferramentas específicas do ecossistema Python.

1. Coleta e limpeza de dados

Essa é uma das etapas mais críticas do Machine Learning, pois a qualidade do modelo depende diretamente da qualidade dos dados.

O que envolve:

- Coleta de dados a partir de arquivos (CSV, Excel, JSON)

- Integração com bancos de dados

- Consumo de APIs

- Remoção de dados inconsistentes ou duplicados

- Tratamento de valores ausentes

- Padronização de formatos

Bibliotecas usadas:

- Pandas

- NumPy

Exemplo de atividades comuns:

- Preencher valores nulos com média ou mediana

- Remover outliers

- Converter tipos de dados

Dados mal tratados resultam em modelos imprecisos, mesmo com algoritmos avançados.

2. Análise exploratória

A análise exploratória permite entender o comportamento dos dados antes da modelagem.

O que envolve:

- Estatísticas descritivas

- Visualização de distribuições

- Identificação de correlações

- Detecção de padrões e anomalias

Bibliotecas usadas:

- Pandas

- Matplotlib

- Seaborn

Objetivo principal:

Compreender como as variáveis se relacionam e identificar quais podem ter impacto real no modelo.

Essa etapa orienta decisões importantes nas próximas fases.

3. Seleção de features

Features são as variáveis usadas pelo modelo para aprender padrões.

O que envolve:

- Selecionar variáveis relevantes

- Criar novas features a partir de dados existentes

- Normalização e padronização

- Codificação de variáveis categóricas

Bibliotecas usadas:

- Pandas

- Scikit-learn

Exemplos práticos:

- Transformar datas em dia, mês e ano

- Normalizar valores numéricos

- Converter categorias em valores numéricos (One-Hot Encoding)

Uma boa engenharia de features pode melhorar significativamente o desempenho do modelo.

4. Treinamento do modelo

Nessa etapa, o algoritmo aprende padrões a partir dos dados preparados.

O que envolve:

- Escolha do algoritmo

- Separação de dados em treino e teste

- Ajuste de parâmetros

Treinamento propriamente dito

Bibliotecas usadas:

- Scikit-learn

- TensorFlow

- PyTorch

Exemplo de algoritmos comuns:

- Regressão Linear

- Árvores de decisão

- Random Forest

- Redes neurais

O objetivo é encontrar um modelo que generalize bem para dados nunca vistos.

5. Avaliação de desempenho

Após o treinamento, o modelo precisa ser avaliado de forma objetiva.

O que envolve:

- Medição da precisão do modelo

- Comparação entre diferentes algoritmos

- Identificação de overfitting e underfitting

Métricas comuns:

- Acurácia

- Precisão e recall

- F1-score

- Erro médio absoluto (MAE)

- Erro quadrático médio (MSE)

Essa etapa garante que o modelo realmente entrega valor e não apenas bons resultados nos dados de treino.

6. Deploy e monitoramento

Depois de validado, o modelo é colocado em produção para uso real.

O que envolve:

- Exportação do modelo treinado

- Integração com APIs ou sistemas

- Monitoramento de performance ao longo do tempo

- Re-treinamento quando necessário

Tecnologias comuns:

- APIs REST

- Docker

- Serviços em nuvem

- MLOps

Com o tempo, os dados mudam, e o modelo precisa ser monitorado para evitar perda de desempenho.

Esse pipeline não é rígido. Em projetos reais, as etapas são iterativas, e ajustes são feitos constantemente com base nos resultados obtidos.

Dominar esse fluxo é essencial para desenvolver soluções de Machine Learning com Python confiáveis, escaláveis e prontas para produção.

Principais bibliotecas de Machine Learning em Python

Existem inúmeras bibliotecas prontas para trabalhar com IA, veremos alguns exemplos muito utilizados.

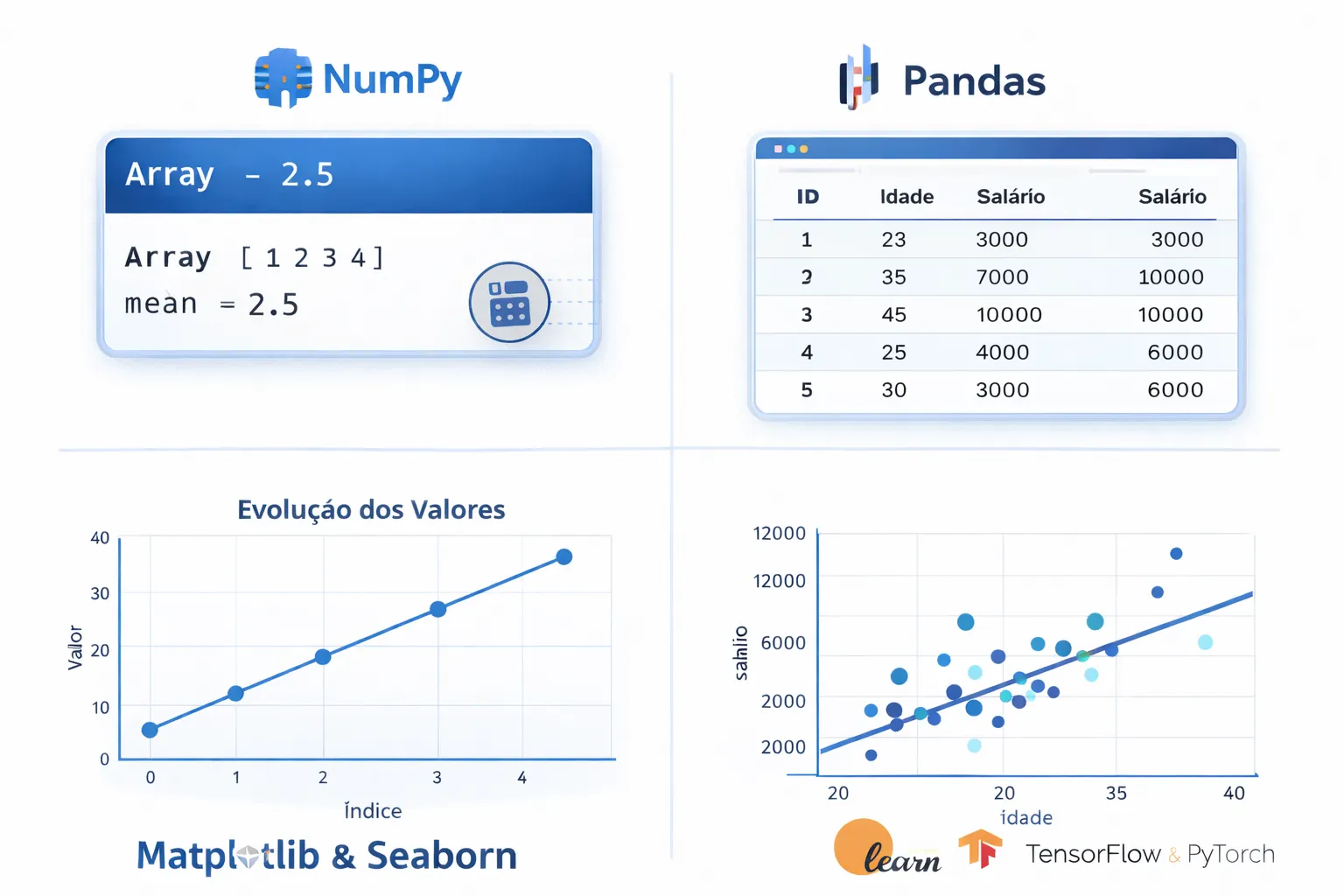

NumPy

NumPy é a base da computação numérica em Python. Ele fornece estruturas eficientes para trabalhar com arrays, vetores e matrizes, além de operações matemáticas de alto desempenho usadas internamente por bibliotecas como Pandas, Scikit-learn e TensorFlow.

O que esse código faz?

np.array([1, 2, 3, 4])cria um array NumPy a partir de uma lista Pythonnp.mean(array)calcula a média aritmética dos valores- O resultado armazenado em

mediaserá2.5

Esse tipo de operação é comum em pré-processamento de dados e cálculos estatísticos usados em Machine Learning.

import numpy as np array = np.array([1, 2, 3, 4]) media = np.mean(array)

Pandas

Pandas é usado para leitura, limpeza, transformação e análise de dados estruturados, geralmente em formato tabular (CSV, Excel, bancos de dados).

O que esse código faz?

pd.read_csv("dados.csv")lê um arquivo CSV e cria um DataFrame- Um DataFrame é uma estrutura de dados tabular com linhas e colunas

df.head()exibe as primeiras 5 linhas do conjunto de dados

Essa etapa é essencial antes de aplicar qualquer algoritmo de Machine Learning.

import pandas as pd

df = pd.read_csv("dados.csv")

print(df.head())

Scikit-learn

Scikit-learn fornece implementações prontas de algoritmos clássicos de Machine Learning, como regressão, classificação e clustering, com foco em simplicidade e padronização.

O que esse código faz?

LinearRegression()cria um modelo de regressão linearfit(X_treino, y_treino)treina o modelo usando dados de entrada (X) e valores reais (y)

O modelo aprende a relação matemática entre as variáveis para fazer previsões futuras

from sklearn.linear_model import LinearRegression

modelo = LinearRegression()

modelo.fit(X_treino, y_treino)

Matplotlib e Seaborn

Essas bibliotecas são usadas para visualização de dados, permitindo identificar padrões, outliers e tendências antes ou depois do treinamento dos modelos.

Exemplo com Matplotlib:

import matplotlib.pyplot as plt

valores = [10, 20, 30, 40]

plt.plot(valores)

plt.title("Evolução dos Valores")

plt.xlabel("Índice")

plt.ylabel("Valor")

plt.show()O que esse código faz?

- Cria um gráfico de linha simples

- Mostra a evolução dos valores ao longo de um índice

- Facilita a análise visual do comportamento dos dados

Exemplo com Seaborn:

import seaborn as sns

import pandas as pd

dados = pd.DataFrame({

"idade": [23, 35, 45, 25, 30],

"salario": [3000, 7000, 10000, 4000, 6000]

})

sns.scatterplot(data=dados, x="idade", y="salario")O que esse código faz?

- Cria um gráfico de dispersão

- Analisa a relação entre idade e salário

- Seaborn oferece gráficos mais elegantes e com menos configuração que o Matplotlib

TensorFlow

TensorFlow é um framework de Deep Learning usado para criar, treinar e escalar redes neurais artificiais, muito utilizado em ambientes de produção.

O que esse código faz?

- Cria uma rede neural sequencial

- A primeira camada possui 10 neurônios com função de ativação ReLU

- A camada final gera uma saída numérica

- O modelo é preparado para treinamento usando o otimizador Adam

import tensorflow as tf from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense modelo = Sequential([ Dense(10, activation="relu"), Dense(1) ]) modelo.compile(optimizer="adam", loss="mse")

PyTorch

PyTorch é um framework de Deep Learning focado em flexibilidade e controle, muito utilizado em pesquisa e projetos avançados de IA.

O que esse código faz?

- Define uma rede neural personalizada

nn.Linear(10, 1)cria uma camada totalmente conectada- O método

forwarddefine como os dados passam pela rede - PyTorch permite controle total do fluxo de treinamento

import torch import torch.nn as nn class Modelo(nn.Module): def __init__(self): super().__init__() self.camada = nn.Linear(10, 1) def forward(self, x): return self.camada(x) modelo = Modelo()

Por onde evoluir após os fundamentos

Após dominar os conceitos iniciais de Machine Learning com Python, o próximo passo envolve:

- Deep Learning e redes neurais

- Processamento de Linguagem Natural (NLP)

- Visão computacional

- MLOps e deploy de modelos

- Integração com APIs e sistemas reais

Essas áreas exigem maior base matemática e prática contínua, mas abrem portas para projetos de alto impacto.

Machine Learning com Python é a base da Inteligência Artificial moderna, combinando simplicidade, poder computacional e um ecossistema robusto de bibliotecas. Ao compreender os conceitos fundamentais e as principais ferramentas, desenvolvedores conseguem criar soluções inteligentes com rapidez e eficiência.

O domínio dessa área amplia significativamente as possibilidades profissionais e técnicas. O próximo passo é aprofundar-se em modelos mais avançados e projetos práticos. Comece experimentando, treinando modelos e evoluindo continuamente.

FAQ (Perguntas Frequentes)

Sim. Python possui sintaxe simples e bibliotecas maduras que facilitam o aprendizado progressivo de Machine Learning.

Conhecimentos básicos de estatística, álgebra linear e probabilidade são importantes, mas podem ser aprofundados conforme a prática evolui.

Para muitos casos, sim. Projetos de classificação, regressão e clustering são amplamente implementados com Scikit-learn em produção.